こちらは、AI TOP reviewsで公開されているレビューブログの要約記事です

Chat GPTで要約し、初心者の方でもわかりやすいように注釈を入れた紹介記事となります。

元記事:「Enhance LLM Application observability on Dify with LangSmith and Langfuse」AI reviews

https://dify.ai/blog/dify-integrates-langsmith-langfuse

用語解説

- LLM(大規模言語モデル): 人工知能の一種で、人間のような文章を生成したり理解したりできる高度なコンピュータープログラム。

- アプリケーション観測: アプリの動作や効率を監視すること。

- LLMOps: LLMを使ったアプリを効率よく開発・運用するための方法や考え方。

- プロンプト: LLMに与える指示や質問。

- トークン: LLMが処理する言葉の単位。

- オープンソース: プログラムの設計図が公開されていて、誰でも自由に使ったり改良したりできるもの。

- プラットフォーム: さまざまなサービスやアプリケーションを開発・実行するための基盤となるシステム。

- インテグレーション: 複数のシステムやソフトウェアを組み合わせて、一つの統合されたシステムとして機能させること。

- ワークフロー: 作業の一連の流れや手順のこと。

- ノード: ワークフローの中の個々の作業や処理の単位。

- 推論: AIが学習した知識を基に、新しい状況に対して判断や予測を行うこと。

- API: アプリケーション・プログラミング・インターフェース。異なるソフトウェア同士が互いにやり取りするための仕組み。

- コンテナ化: アプリケーションとその実行に必要な環境を一つのパッケージにまとめる技術。

要約

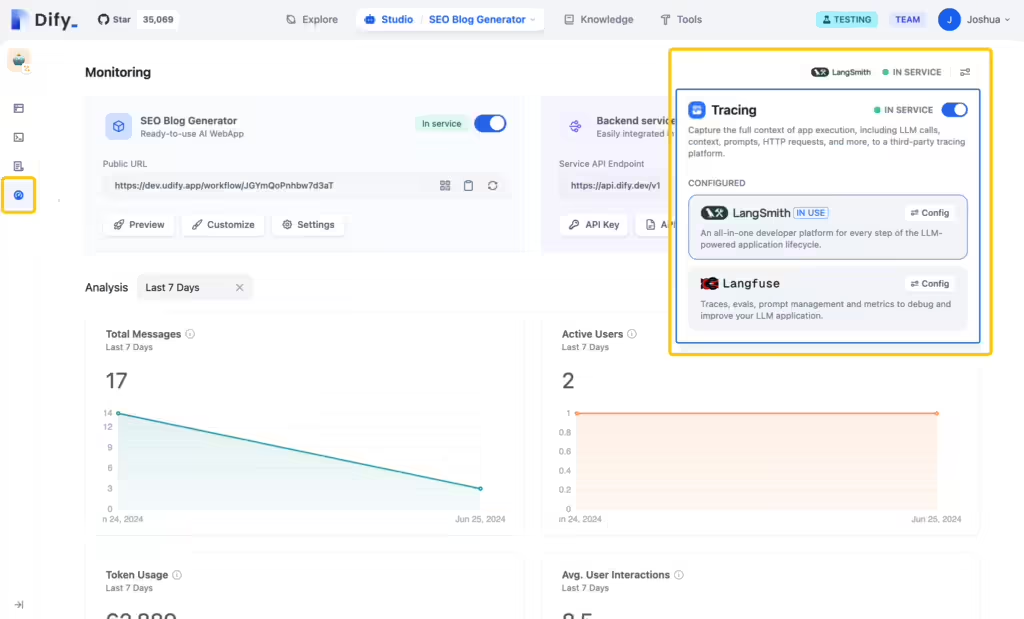

Difyが、LangSmithとLangfuseという新しいLLMアプリケーション観測ソリューションを統合(インテグレーション)したことを発表しました。この統合により、Difyで作られたLLMアプリケーションの品質とコストを追跡・評価することが可能になります。

Difyのバージョン0.6.12では、LangSmithとLangfuseという2つの強力なLLMアプリケーション観測ツールが組み込まれました。簡単な設定で、ユーザーは詳細なアプリケーションデータを見ることができ、Difyで作ったLLMアプリケーションの品質、性能、コストを評価しやすくなりました。

この新しいツールの導入は、アプリケーションの展開を加速し、継続的な改善をサポートすることで、より費用対効果の高いLLMアプリケーションの作成を可能にします。

LLMは優れた推論と文章生成能力を持っていますが、その内部の仕組みはまだよくわかっていない部分があります。Difyワークフローで構築されたLLMアプリケーションは、多くの場合、複数のノードを含む複雑な構造を持っています。そのため、運用監視が開発プロセスの重要な部分となっています。

LLMOpsの考え方に基づき、DifyはLangSmithとLangfuseを使って以下のようなサポートを提供します:

- 適切なモデルの選択:Difyは主要なLLMに対応しており、ユーザーのニーズに合った最適なモデルを選べます。

- 効果的なプロンプトの作成:Difyは使いやすいプロンプト編集画面を提供し、LangSmithとLangfuseと組み合わせることで、プロンプトの効果を細かく追跡・分析できます。

- 性能の監視:LangSmithとLangfuseを通じて、Difyで作られたLLMアプリケーションの正確さ、応答速度、リソース使用量などを総合的に監視できます。

- 継続的な改善:LangSmithとLangfuseは詳細な監視指標を提供します。これらの指標とLLMの回答に対する手動評価を組み合わせることで、アプリケーションを継続的に改善し、ユーザー体験を向上させることができます。

- コスト最適化:Difyは基本的なリソース使用統計を提供し、LangSmithとLangfuseはそれを補完する形で詳細なコストとトークン使用量の分析を提供します。これにより、リソースの割り当てを効率的に最適化できます。

LangSmithとLangfuseは、どちらもオープンソースで、自分のサーバーにインストールして使うこともできます。特にLangfuseは、完全なAPIとデータエクスポート機能を提供し、コンテナ化された展開をサポートしています。これらのツールを使うことで、Difyユーザーはより透明性が高く、継続的に改善可能なLLMアプリケーションを作れるようになります。

まとめ

AIテクノロジーの急速な進歩と、それに伴う開発ツールの重要性を強調しています。Difyが導入したLangSmithとLangfuseは、LLMアプリケーションの開発者にとって非常に有益なツールだと感じます。特に印象的なのは、これらのツールがアプリケーションの品質、性能、コストを細かく分析できます。